Nawet 97 proc. kont zgłaszanych administratorom największych portali społecznościowych w związku z mizoginią i nawoływaniem do przemocy wobec kobiet nadal jest aktywnych. Użytkownicy i użytkowniczki raportują o przypadkach szerzenia mowy nienawiści, potem długie miesiące czekają na reakcję serwisów i… nic.

Nie tylko Facebook, jak ujawniła niedawno jego była pracownica, nie chce walczyć ze szkodliwymi publikacjami, choć ma ku temu narzędzia. Marianna Spring, reporterka BBC, która zajmuje się fact checkingiem (odkłamywaniem fake newsów i teorii spiskowych – w Polsce robi to np. Konkret24), otrzymywała mnóstwo wiadomości z obelgami i pogróżkami. Większość była jakoś powiązana z jej płcią: groźby dotyczyły m.in. gwałtu.

To skłoniło Spring do przyjrzenia się realnym działaniom, jakie media społecznościowe rzekomo podejmują w walce z mową nienawiści wobec kobiet. Stworzyła fikcyjnego użytkownika największych platform społecznościowych o imieniu Barry. Był on mizoginem, ale również fanem teorii spiskowych.

Już po dwóch (!) tygodniach jego aktywności w sieci wśród proponowanych mu postów i stron dominowały te, które jawnie promują antykobiece treści. Co ciekawe, algorytmy nie rekomendowały Barry’emu teorii spiskowych. Te są na cenzurowanym od czasu, gdy na początku pandemii w mediach społecznościowych namnożyło się wpisów publikowanych przez antyszczepionkowców, przede wszystkim o tym, że żadnego koronawirusa nie ma. Swoje zrobił też Donald Trump, postując histeryczne wpisy o tym, że to on rzekomo wygrał zeszłoroczne wybory prezydenckie w Stanach Zjednoczonych. Jego wypociny były początkowo przez Twittera zasłaniane specjalnym filtrem z ostrzeżeniem, że sieją nieprawdę. Dopiero potem został zablokowany na TT, a później FB.

W przeciwieństwie do fake newsów nienawiść wobec kobiet nie wydaje się administratorom portali społecznościowych aż tak poważną sprawą. Takimi treściami bombardowany jest nie tylko nieistniejący w rzeczywistości Barry. Z raportu Centre for Countering Digital Hate wynika, że z 330 wpisów zgłoszonych w związku z mizoginią aż 97 proc. nadal jest widocznych.

Co oznacza, że jeśli ktoś nienawidzi kobiet, to algorytmy szybko go odnajdą i nagrodzą odpowiednio nienawistnymi treściami.

Wojna o OnlyFans: Za wszystko inne (niż porno) zapłacisz kartą MasterCard

czytaj także

Algorytm algorytmowi nierówny

Facebooka używają niemal trzy miliardy ludzi z całego świata. W zeszłym roku każdy z nich zarobił dla firmy Marka Zuckerberga 32 dolary dzięki adresowanym do niego reklamom. Łatwo więc policzyć, dlaczego Facebookowi nie spieszy się do cenzurowania treści.

Zresztą nie chodzi tylko o pieniądze. Social media, w sumie słusznie, postawiły sobie za cel być apolityczne. Dlatego każda próba walki z mową nienawiści spotyka się z oporem drugiej strony, krzyczącej o zamachu na jej poglądy i wolność słowa. Problem z tak postawionym argumentem jest taki, że stawia on znak równości pomiędzy faktami potwierdzonymi naukowo a teoriami wyssanymi z palca. Jeśli jakaś platforma blokuje te drugie, to wyznawcy fake newsów czują się wykluczeni z wolnej debaty.

Syndrom Elizabeth Holmes. Jak głośne oszustwo utrudniło życie kobietom w branży tech

czytaj także

Jak sprawdziła dziennikarka BBC, z antykobiecymi treściami najbardziej narzucały się Barry’emu Instagram i Facebook. Mizoginiczne szarże Barry’ego nie doczekały się natomiast niemal żadnej odpowiedzi na TikToku. Może najbardziej młodzieżowe medium, które wielokrotnie dało się poznać jako solidarne z osobami LGBT+ i umiejętnie rozgrywało Trumpa, odcina się od mizoginii, bo odsetek zainteresowanych takimi treściami użytkowników jest na tyle znikomy, że nie ma wpływu na jego dochody. Co innego Facebook, który ma znacznie więcej odbiorców w różnych grupach wiekowych.

Wydaje się zatem, że dla różnych mediów społecznościowych istnieją lepsze i gorsze odmiany mowy nienawiści. Lepsze, czyli te, z którymi social media rzeczywiście walczą (albo przynajmniej próbują), to z reguły te, o których robi się głośno i które budzą powszechny odzew na świecie. W tę kategorię wpisuje się właśnie Trump ze swoimi fake newsami o wyborach w USA czy zwolennicy teorii, że COVID-19 to ściema. Gorsze to te, do których administratorzy nie przywiązują wagi na co dzień, te, które przynajmniej w danym momencie nie cieszą się powszechnym zainteresowaniem: jak mizoginia czy antysemityzm.

Skoro już mowa o tym ostatnim, jak odnotowało Center for Countering Digital Hatred, aż 80 proc. zgłoszonych postów o wydźwięku antyżydowskim również pozostawało dostępnych w sieci. Największą porażkę na tym polu zaliczyło Google, które nie usunęło antysemickich komentarzy z najbardziej oczywistego miejsca, w jakim mogły się one pojawić i jakie należało być może specjalnie pod tym kątem monitorować. Chodzi o recenzje Muzeum Auschwitz-Birkenau w mapach Google.

Dziennikarze „Guardiana” zgłosili administratorom 153 naprawdę wstrząsające i obrzydliwe komentarze. Minęła doba i nadal można było je przeczytać. Zniknęły dopiero po ukazaniu się artykułu na ten temat, w którym pojawia się ogólnikowa wypowiedź rzecznika firmy: „Jesteśmy oburzeni tymi recenzjami […] i podejmujemy działania, żeby usunąć te treści oraz zapobiec nadużyciom w przyszłości […] Mamy jasną politykę, która zabrania publikowania obraźliwych i nieprawdziwych recenzji […] przez całą dobę śledzimy, co się dzieje na Mapach. W tym przypadku wiemy, że musimy się poprawić […] pracujemy nad ewaluacją i poprawą naszych systemów detekcji”.

czytaj także

Czy „wykrycie” antysemickich wpisów w recenzjach dawnego obozu zagłady wymaga jakichś szczególnie wyrafinowanych „systemów detekcji”? Aż chce się powiedzieć sowicie opłacanym programistom Google’a: „Mieliście tylko jedno zadanie, a i tak zawaliliście”.

Tylko że znowu: to nie kwestia czyjejkolwiek nieudolności, która służy tu oczywiście za uniwersalną wymówkę. Można byłoby stworzyć algorytm na tyle dobry, żeby usuwał takie treści z automatu, albo zatrudnić człowieka, który godzinami wpatrywałby się w tę konkretną sekcję komentarzy i wywalał z niej każdy antysemicki wyrzyg. Tylko że to się niestety nie opłaca.

Gniew napędza sprzedaż

O tym, że algorytmy nie są politycznie neutralne, mówi wprost Frances Haugen, analityczka danych i do niedawna pracownica Facebooka, która ujawniła mediom tysiące wewnętrznych dokumentów firmy. Wynika z nich, że administratorzy FB świadomie podbijają treści, które budzą gniew użytkowniczek i użytkowników, bo dzięki temu dłużej utrzymują ich zainteresowanie i zarabiają na nich więcej pieniędzy.

Algorytmy można byłoby napisać inaczej, ale nikomu na tym nie zależy. „Wersja Facebooka, która istnieje dzisiaj, dzieli nasze społeczeństwa i powoduje przemoc etniczną na całym świecie” – mówiła Haugen w programie 60 Minutes.

Zanim sygnalistka się ujawniła, dostarczyła skopiowane przez siebie dokumenty redakcji „Wall Street Journal”. To ona jako pierwsza napisała, że Facebook świadomie szkodzi, przyniosła dowody, jak jego algorytmy celowo pogłębiają złą samoocenę nastoletnich dziewcząt czy zaogniają podziały polityczne w USA. Według Haugen firmie Zuckerberga przyświeca zasada, że „łatwiej jest zainspirować ludzi do gniewu niż do innych emocji”. Facebook ma nawet stosować inne algorytmy w czasie wyborów, kiedy poziom emocji jest podwyższony, a inne w sytuacjach, gdy w polityce nie dzieje się nic znaczącego.

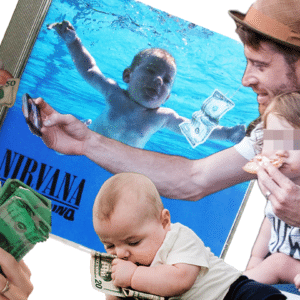

Mamo, tato, a może sami byście wystąpili na golasa na okładce płyty Nirvany?

czytaj także

Czystych rąk nie ma też Twitter. Z wewnętrznego raportu firmy, na który powołuje się „The Guardian”, wynika, że platforma ta promuje tweety prawicowych polityków w większym stopniu niż te publikowane przez polityków o innych poglądach. Na potrzeby swojego badania Twitter badał zasięgi wpisów na wallu uporządkowanym chronologicznie, od najnowszego do najstarszego, oraz na ułożonym przez algorytmy. Okazało się, że tam, gdzie o zasięgu wpisu decydował algorytm, jednoznacznie zwyciężały treści prawicowe. Największy rozdźwięk był w Kanadzie, gdzie wpisy liberałów miały 43 proc., a konserwatystów 112 proc., oraz w Wielkiej Brytanii, gdzie zwolennicy Partii Pracy osiągali 112 proc., a konserwatyści 176 proc. zasięgów. Wyniki nie zmieniły się znacząco, gdy z badania wykluczono tweety najważniejszych polityków.

Media społecznościowe są w potrzasku, bo nadal starają się być jednocześnie miejscem dla wszystkich. Dlatego przymilają się nieobliczalnym hejterom, stając się miejscem niebezpiecznym dla nastolatków, kobiet, osób LGBT+ czy innych grup dyskryminowanych. Efekt? Najmłodsi postrzegają przez to Facebooka jako medium dla ramoli, a starsi nie nadążają za TikTokiem. Twitter w Polsce stał się ulubioną tubą prawicowych publicystów.

Szefowie mediów społecznościowych doskonale o tym wiedzą i rozpaczliwie z tym walczą, zamiast pójść w ślady mediów tradycyjnych i pogodzić się z faktem, że pewnych użytkowników prędzej czy później stracą. Szkoda byłoby cieszyć się opinią bezpiecznej przystani dla różnej maści wariatów i zostać tylko z incelami czy miłośnikami teorii o „plandemii”, którzy są może głośni i zaangażowani w komentowanie, ale też zwyczajnie niebezpieczni.