W dobie wielu globalnych kryzysów społecznych i ekonomicznych, w tym pandemii, warto pamiętać o Adzie Lovelace – wiktoriańskiej twardzielce i wizjonerce myśli technicznej. Wyzwania teraźniejszości i przyszłości będą wymagać nowatorskich rozwiązań, a te biorą się z różnorodności. Dlatego w kreowaniu technologii przyszłości musimy promować wielość i różnorodność kobiet.

Umożliwianie kobietom uczestnictwa w rozwiązywaniu wielkich problemów społecznych jest bezwzględną koniecznością. Wszystko zaczyna się od decyzji, kto uczestniczy w definiowaniu tych problemów i kreśleniu ich rozwiązań za pomocą najnowocześniejszych technologii, zwłaszcza sztucznej inteligencji. A w tradycyjnych strukturach firm informatycznych i urzędów państwowych potrzeba nowego myślenia strategicznego. Promowania takich właśnie zmian podejmuje się nasz sojusz <A+> Alliance for Inclusive Algorithms.

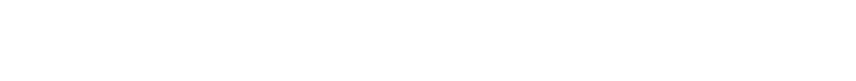

Powszechnie wiadomo, że branża sztucznej inteligencji charakteryzuje się:

– brakiem różnorodności w zespołach. Systemy inicjują, planują, budują i wdrażają głównie mężczyźni. W ostatnich latach liczba kobiet uczestniczących w tego typu projektach nie tylko nie rośnie, ale wręcz spada.

– brakiem różnorodności w samych danych i algorytmach. Algorytmy nie tylko polecają użytkownikom wiadomości, obrazy, muzykę czy filmy. Uczestniczą też w podejmowaniu decyzji o tym, komu udzielić kredytu, komu pozwolić wyjść z aresztu za kaucją, kogo przyjąć do pracy, komu przyznać zasiłek, jak kogoś leczyć i tym podobne. Nietrafione sugestie maszyn mogą więc doprowadzić do kryzysu ich wiarygodności.

– brakiem różnorodności typów organizacji, które dziś budują najnowocześniejsze systemy sztucznej inteligencji. Naukowej produkcji sztucznej inteligencji przewodzi garstka amerykańskich i chińskich firm, a nie uniwersytety, centra badawcze, organizacje pozarządowe czy oddolne.

Skutek jest taki, że chociaż w fizycznym świecie role płciowe powoli się zacierają, stare stereotypy i uprzedzenia związane z płcią, rasą czy klasą społeczną zostają trwale wpisane w powstające dziś modele sztucznej inteligencji i zautomatyzowanego podejmowania decyzji.

Według Światowego Forum Ekonomicznego kobiety stanowią zaledwie około 22 proc. osób tworzących dziś sztuczną inteligencję. Ponadto większość z nich pracuje w dziesięciu najbogatszych krajach świata. Liczby te nie obejmują niewidocznych i źle wynagradzanych data cleanerek i content moderatorek ani pracowników i pracownic dorywczych z Globalnego Południa. Dla nich wszystkich dotarcie do decydentów i inwestorów – nie mówiąc już o staniu się nimi – graniczy z niemożliwością.

Podobnie niepokojący i jeszcze bardziej nieakceptowalny jest brak odpowiedniej polityki i standardów odzwierciedlających równość społeczną w samych algorytmach. Jeśli stare dane i stare modele nie zostaną wyparte, a wręcz się utrwalą, czeka nas jeszcze bezwzględniejszy Patriarchat 2.0.

W nadchodzących miesiącach politycy na całym świecie będą podejmować ważne decyzje w sprawie zazębiających się kryzysów – od przyznawania milionów dolarów w funduszach pomocowych po nowe inwestycje w systemy ochrony zdrowia. Całe regiony szykują się już do przejścia na zieloną gospodarkę. A duża część nowych inwestycji i infrastruktury będzie się opierać na rozwiązaniach informatycznych. Dlatego niezbędne jest włączanie kobiet na każdym etapie innowacji.

Sojusz <A+> Alliance for Inclusive Algorithms proponuje całościowe podejście do problemu wykluczenia społecznego w branży nowych technologii – począwszy od jego przyczyn.

Wzywamy do tego, by w tworzeniu, projektowaniu i kodowaniu oprogramowania, którego pragniemy, brały udział kobiety i dziewczęta, reprezentujące różnorodne środowiska, w liczbach równych mężczyznom.

Należy więcej inwestować w edukację techniczną kobiet i dziewcząt i planować nowe strategie takiej edukacji. Chcemy także, by różnorodne kobiety czynnie i od samego początku uczestniczyły we wszystkich procesach rozwoju sztucznej inteligencji – bo ona dotyka każdego aspektu naszego życia.

Jesteśmy przekonane, że żywe uczestnictwo kobiet i dziewcząt – pochodzących z osad, wsi i miast, ze szkół podstawowych, średnich i wyższych – będzie skutkować bardziej przemyślanymi decyzjami dotyczącymi projektowania i wdrażania sztucznych inteligencji. Dziś bowiem decyzje te podejmowane są przez urzędników, prywatne firmy, inżynierów i menadżerów o wiele kilometrów odległych od społeczności, którym mają służyć, i problemów, które mają rozwiązywać.

Wierzymy, że na każdym etapie opracowywania i wdrażania sztucznych inteligencji nie tylko jest miejsce na bezpośrednie eksperckie doświadczenie kobiet i dziewcząt oraz na ich wkład, uczestnictwo i współtwórstwo, ale wręcz, że są one tam niezbędne.

Wzywamy do wprowadzenia „akcji afirmatywnej w algorytmach”, która będzie korygowała ich tendencyjność od najwcześniejszych etapów projektowania. Chcemy mieć algorytmy oparte na definicjach problemów i propozycjach rozwiązań formułowanych przez osoby z bezpośrednim doświadczeniem tych problemów. Opowiadamy się za przyjęciem zaleceń, które ustanawiałyby standardy sprawiedliwości, odpowiedzialności i przejrzystości zautomatyzowanego podejmowania decyzji zarówno w sektorze publicznym, jak i prywatnym. Chcemy otwierać czarne skrzynki algorytmów i likwidować ich tendencyjność.

Nie potrzeba dyplomu politechniki, żeby z własnego doświadczenia wiedzieć, jakie systemowe rozwiązania należy wprowadzać w społeczeństwie na szeroką skalę – tak by obejmowały liczniejsze grupy ludzi i lepiej im służyły. Dzięki wiedzy terenowej z feministyczną podbudową, wykorzystywanej przez bardziej różnorodne zespoły złożone z informatyków i informatyczek, specjalistów i specjalistek od uczenia maszynowego, naukowców i naukowczyń zajmujących się dużymi zbiorami danych oraz matematyków i matematyczek, można stworzyć sojusz, który zajmowałby się usuwaniem systemowych nierówności płciowych i rasowych potencjalnie wpisanych w nowe technologie. Naszym zdaniem jest to lepsza droga niż sięganie po przestarzałe systemy i założenia, optymalizacja ich skuteczności i digitalizacja dawnych uprzedzeń na wielką skalę, żeby potem – w razie czego – korygować je po szkodzie.

Biorąc pod uwagę tempo, w jakim wdraża się sztuczną inteligencję, i zautomatyzowane podejmowanie decyzji, ziarno inkluzywności, interdyscyplinarności i różnorodności płciowej, rasowej i klasowej trzeba zasiać już teraz, jeśli ma wzrosnąć w przyszłości. Jesteśmy gotowe tę przyszłość przybliżyć, osadzając niecierpiącą zwłoki walkę z pandemią COVID-19 w kontekście równie pilnej potrzeby stworzenia nowych, bardziej demokratycznych systemów, dzięki którym wszyscy ludzie będą mogli żyć jak najpełniej.

Nasza propozycja jest rozsądna i możliwa do sprawdzenia w pilotażu. Otwórzcie sale konferencyjne i zaproście kobiety i dziewczęta do okrągłych stołów, by mogły z wami dyskutować o interwencjach technologicznych – w tym związanych ze sztuczną inteligencją i pomagających zażegnać obecny kryzys. Przetestujcie model partycypacyjny. Przekonajcie się, jaka będzie różnica w rezultatach, czyli wspólnej przyszłości, na którą zasługujemy. Zauważcie i zagospodarujcie potencjał kobiet i dziewcząt. Raz po raz powtarzajcie ten proces. Gdy tylko otworzy się przestrzeń na innowacyjne myślenie, będziemy mieli na świecie miliony Ad Lovelace. Tylko że środowisko, w którym ich idee zakwitną, trzeba utworzyć już teraz.

*

Pod tekstem podpisały się Renata Avila, członkini rady doradczej <A+> Alliance, oraz Caitlin Kraft-Buchman, Nuria Oliver, Elisa Celis i Nanjira Sambuli.

<A+> jest multidyscyplinarną, różnorodną, globalną i feministyczną koalicją naukowczyń i działaczek dążących do tworzenia i stosowania algorytmów, które nie tylko wykrywają, ale i korygują uprzedzenia oparte na płci wbudowane w sztuczną inteligencję i zautomatyzowane podejmowanie decyzji.

**

Renata Avila jest dyrektorką wykonawczą chilijskiej fundacji Ciudadano Inteligente. Jako prawniczka specjalizuje się w międzynarodowych regulacjach dotyczących praw człowieka. Zasiada w radzie fundacji Creative Commons i jest członkinią komitetu koordynacyjnego DiEM 25.

Artykuł opublikowany w magazynie openDemocracy na licencji Creative Commons. Z angielskiego przełożyła Aleksandra Paszkowska.

Wspieraj

Wspieraj

Wspieraj

Wspieraj  Wydawnictwo

Wydawnictwo

Obserwuj

Obserwuj

!["Odwagi! [o zaangażowaniu młodych]" Dominika Lasota](https://krytykapolityczna.pl/wp-content/uploads/2026/04/odwagi-plomienie-okladka-173x267.jpg)

![Utracony kompas [o europejskiej lewicy]](https://krytykapolityczna.pl/wp-content/uploads/2026/03/plomienie_utracony_kompas-171x267.jpg)