Możliwe, że epoka świetnych zarobków informatyków dobiega końca. Ci słabsi mogą nagle znaleźć się w miejscu, gdzie dzisiaj znajdują się pogardzani przez nich i „sami winni swojemu losowi” prekariusze.

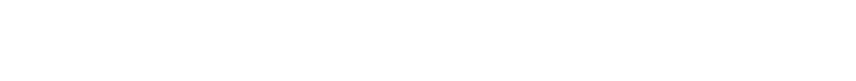

Przez ostatnie dwie dekady mało której grupie zawodowej wiodło się tak dobrze jak informatykom. Kombinacja kilku czynników – technologicznych, gospodarczych i społecznych – pchała ją w górę. Cena ich pracy – a tym samym pensje w branży – rosły po kilka, kilkanaście procent rocznie. Zupełnie wbrew globalnym trendom, które kolejne grupy zawodowe spychały w prekariat, z klasy wyższej do średniej, ze średniej do niższej. Tak stało się z handlowcami, potem dziennikarzami, a ostatnio także prawnikami. I wieloma innymi zawodami wymagającymi wyższego wykształcenia i ciężkiej pracy.

Mimo to branża nadal zgłaszała popyt na nieobsadzone stanowiska. W Polsce 30–50 tysięcy, a w całej Europie ten niedobór szacowany jest na ponad pół miliona. Popyt przez wiele lat przeganiał podaż, skutkiem czego do zawodu weszły grupy „z okolic”: inżynierowie innych specjalności, matematycy, a nawet humaniści zatrudniani do testów, analizy biznesowej czy interakcji człowiek-maszyna (HCI). W ostatnich latach ułatwiły to kursy zawodowe (tzw. bootcampy), które namnożyły się jak grzyby po deszczu i oferują bilet wstępu do atrakcyjnego zawodu już po kilku miesiącach, pół roku czy roku praktycznego przygotowania zawodowego.

Istnieją przesłanki, aby twierdzić, że ta epoka dobiega końca. Już w 2017 roku miesięcznik „Wired”, jak żaden inny dobrze zorientowany w trendach światka nowoczesnych technologii, opublikował artykuł pod znamiennym tytułem Is programming the next blue collar job. Wiele wskazuje na to, że prekaryzacja zawodu informatyka już się zaczęła i rzesze tych, którzy podejmują dzisiaj edukację, może znaleźć się w tym samym miejscu, gdzie na początku wieku znaleźli się na przykład ekonomiści – beneficjenci (a może raczej ofiary?) boomu edukacyjnego z lat 90.

Nędza algorytmów, czyli jak ekonomiści z Davos prowadzą nas w przepaść

czytaj także

Zbiega się bowiem kilka czynników, które mogą zmienić reguły gry. Pierwszy z nich to cykl koniunkturalny: już dzisiaj 8 z 10 najbardziej wartościowych przedsiębiorstw świata to spółki technologiczne: Apple, Facebook, Microsoft, Alphabet (Google) czy Amazon. Czy faktycznie wartość, którą wnoszą do światowej wymiany towarowej, jest tak duża, czy może raczej ceny odzwierciedlają oczekiwania co do przyszłych przychodów? A jeśli to drugie, to pytanie nie brzmi „czy” przecena nastąpi, a raczej „kiedy” i „jak głęboka będzie”.

Po drugie, regulacje. Społeczeństwa demokratyczne już zorientowały się, że dżinn technologii wypuszczony z butelki zaczął siać spustoszenie w sferze społecznej, gospodarczej i komunikacyjnej. Regulacje wydają się tylko kwestią czasu. Ujęcie technologii w ramy prawa i urzędów nadzorczych „ucywilizuje” technologię, ale jednocześnie skończy się tym, czym skończyło się w telekomunikacji i bankowości: zmniejszeniem marż i inwestycji, a tym samym spadkiem popytu na specjalistów.

czytaj także

Trzeci czynnik to kwestia podaży: napór wykształconych na programistycznych bootcampach „niebieskich kołnierzyków programowania” sprawi, że spadną pensje wszystkich w branży. Zgodnie z zasadą Kopernika-Greshama, w swoim czasie twórczo rozwiniętą przez prof. Janusza Filipiaka, założyciela spółki ComArch, „każdego specjalistę da się zastąpić skończoną liczbą stażystów”, specjalista gorszy wypiera lepszego – wszędzie tam, gdzie ilość i cena mają największe znaczenie.

Ale najważniejsze są dwa kolejne czynniki. Błyskawiczny rozwój sztucznej inteligencji sprawia, że coraz więcej prac „wyższego rzędu” będzie można powierzyć maszynie. Już dzisiaj radzi sobie ona z analizą języka naturalnego, a zasilona odpowiednimi danymi (czyli kodem z platform takich jak serwis GitHub, przechowujący i bezpłatnie udostępniający miliardy linii kodu tworzonych przez miliony osób) może pisać programy znacznie taniej niż Senior Java Developer, który kosztuje w Stanach ok. 80 tys. dolarów rocznie, a w Polsce – prawdę mówiąc – już więcej niż połowę tej kwoty.

Nowa transformacja ustrojowa: z gospodarki ludzkiej na zautomatyzowaną

czytaj także

I ostatni czynnik: badania podstawowe. Informatyka jako dziedzina nauki korzysta z „paliwa” nauk podstawowych: matematyki, logiki, fizyki ciała stałego, a także psychologii i socjologii. To „paliwo” w dużej mierze zapewniały duże amerykańskie projekty rządowe, zwłaszcza kosmiczne i wojskowe. Świetnym przykładem jest internet: jego prekursor (ARPAnet) był zbudowany jako sieć, która miała łączyć amerykańskie bazy wojskowe nawet w przypadku, gdy część z nich zostanie zniszczona uderzeniem jądrowym.

Dzisiaj badań i projektów na taką skalę się nie prowadzi. Mimo że koncerny technologiczne dosłownie śpią na górze pieniędzy przetrzymywanej w rajach podatkowych (Facebook w raporcie z drugiego kwartału 2018 roku zgłosił 42 miliardy dolarów gotówki), rządy są „za biedne”, aby takie badania finansować. Co oczywiście stanowi punkt wyjścia do kolejnych rozważań na temat zdolności korporacji do unikania płacenia podatków i konsekwencji tego faktu – nie tylko dla rządowych programów socjalnych, ale także dla nauk podstawowych (i w konsekwencji samych koncernów).

Choć sygnały odwrócenia trendu długofalowego są wyraźne, nie można powiedzieć na pewno, że tak się wydarzy, a jeśli się wydarzy, to raczej powoli. Zacznie się „od dołu” – od stanowisk podstawowych, niezwiązanych z głęboką wiedzą techniczną (np. programista czy kierownik projektu). Ludzie z niszowymi kwalifikacjami, wysokimi umiejętnościami „miękkimi”, wiedzą z innych dziedzin (np. bankowość, przemysł, media, zdrowie) oraz siecią kontaktów mogą spać spokojnie. Znaczenie zacznie mieć porządne wykształcenie podstawowe i umiejętność szybkiej zmiany profilu – premię znowu otrzymają ci, którzy umieją się uczyć. Jak zwykle, najlepszy kierunek ucieczki to uciekać do przodu.

Powyższy scenariusz oczywiście obarczony jest pewnym ryzykiem. Warto przypomnieć: prawie ćwierć wieku temu, na początku lat 90. na łamach tygodnika „Newsweek” ukazał się artykuł, że oto narzędzia CASE (Computer Aided Software Engineering), pozwalające na „programowanie” za pomocą diagramów, kwadracików i strzałek, dokonają rewolucji. Zamiast mozolić się z kodem źródłowym w hermetycznym języku programowania, analityk po prostu „narysuje” program – a maszyna sama „przełoży” go na język mikroprocesora, uruchomi, sprawdzi i dostarczy do miejsca wykorzystania.

Nic takiego się nie wydarzyło. Efektywniejsze okazało się zakodowanie intencji analityka w (coraz doskonalszych) językach programowania, a – w erze zwinnych („agile”) metodyk – kwadraciki i strzałki okazały się (pomijanym często) dodatkiem.

czytaj także

Jednak każdego, kto dzisiaj rozwija karierę w IT, warto namówić do przygotowania i posiadania tzw. planu B lub nawet kilku jego wersji. Jak mówił Warren Buffet przy innej okazji, kiedy przypływ ustępuje, widać, kto pływał bez majtek. Jeśli więc ktoś zbudował swój dobrobyt na jednej technologii, nie ma solidnych podstaw, sieci kontaktów, wiedzy z jakiejś dziedziny, umiejętności społecznych oraz zdolności szybkiego i intensywnego uczenia się – może nagle znaleźć się w miejscu, gdzie dzisiaj znajdują się pogardzani przez niego i „sami winni swojemu losowi” prekariusze.