Katarzyna Przyborska: 19 lutego Komisja Europejska przestawiła tzw. Białą księgę AI dotyczącą sztucznej inteligencji. O rozwoju tej ostatniej mówi się często, że jest czymś nieuchronnym, że nie mamy nad tym kontroli. W dodatku na poziomie politycznym sztuczną inteligencję ludziom trudno zrozumieć, nie do końca wiadomo, jak sobie wyobrazić algorytmy i związane z nimi niebezpieczeństwa. To wszystko wywołuje w nas bierność.

Katarzyna Szymielewicz: Tak naprawdę to ci, którzy używają dziś zaawansowanej technologii do zbierania i analizy danych, a zarazem ci, którzy wiedzą o nas najwięcej – czyli wiodące firmy technologiczne − chcieliby, żebyśmy postrzegali AI właśnie w ten sposób: jako coś nieuchronnego. Inwestują w tę defetystyczną narrację, bo to ona sprawia, że politycy i zwykli ludzie niczego od nich nie oczekują. Nie oczekują odpowiedzialności – mimo że powinni.

Dlatego naszym zadaniem jest rozbrajanie tej narracji. I wymaganie odpowiedzialności od tych, którzy sprawują realną władzę nad danymi. To mit, że AI jest autonomiczna wobec człowieka, że jest jak żywioł. O tym, jak działa i jakie cele realizuje sztuczna inteligencja, decydują ludzie. Mogą mieć na to również wpływ politycy i regulatorzy, np. Komisja Europejska. Przy czym w Białej Księdze AI nie ma jeszcze konkretnych rozwiązań, które przekładałyby się na rozliczalność algorytmów. To dokument programowy, który zaledwie wytycza możliwe kierunki.

Czy jest w nim coś, co cię zaskoczyło?

Najbardziej w tej strategii dziwi mnie fetysz danych. Komisja Europejska ewidentnie daje się porwać typowemu dla firm technologicznych myśleniu: skoro jest tak dużo danych, a będzie jeszcze więcej, to my musimy je wszystkie wykorzystać. Bezrefleksyjne dążenie do tego, żeby te wszystkie dane zbierać, przetwarzać i wyciągać z nich wiedzę o człowieku, jest niebezpieczne i przyniesie więcej społecznej szkody niż pożytku. Potrzebujemy głębokiego namysłu nad tym, w których obszarach gromadzenie danych o ludziach może być korzystne, a w których jest niepotrzebne, a nawet niebezpieczne.

Komisja przyjęła, że nie będzie regulować samej technologii służącej do analizy danych, a jedynie jej najbardziej ryzykowne wykorzystania. Zgadzam się z tym podejściem. Nie mamy wiele czasu, więc skupmy się na tych obszarach, w których ryzyko skrzywdzenia człowieka, szkód społecznych czy ekologicznych jest największe. Tu jednak pojawia się pytanie za milion dolarów: które to są? Nie znamy jeszcze odpowiedzi.

Podejście Komisji Europejskiej do zagadnienia AI jest dość afirmatywne. Jest tu mowa o technologiach przynoszących korzyść ludziom, sprawiedliwej gospodarce, otwartym i demokratycznym społeczeństwie, no i neutralności klimatycznej. Ta optymistyczna postawa KE jest świadomym posunięciem?

Komisja Europejska rzeczywiście w tym dokumencie trochę zaklina rzeczywistość, a jej optymizm co do tego, że da się pogodzić coraz szybszy technologiczny rozwój i ochronę środowiska, brzmi naiwnie. Odbieram to jednak jako świadomy zabieg komunikacyjny, sygnał wysłany w stronę biznesu. Autorzy strategii chcą brzmieć optymistycznie, żeby tylko nie stworzyć wrażenia, że oto znów biurokraci z Brukseli ustawiają się w kontrze do postępu.

Ale też nie chcą przestraszyć ludzi, którzy już mają powody, by sztucznej inteligencji się obawiać. Dlatego Biała księga AI kładzie tak duży nacisk na europejskie wartości i interesy. Pojawiają się piękne idee, takie jak postawienie potrzeb i praw człowieka w centrum, zaprzęgnięcie systemów AI w służbę społeczeństwu, zrównoważony rozwój. Autorzy zdają się wierzyć, że to wszystko naprawdę da się pogodzić.

Mnie się podoba, że Komisja nie ulega regulacyjnemu defetyzmowi, który tak dobrze przyjął się w debacie publicznej i ewidentnie widzi dla siebie aktywną rolę w tej grze. To bardzo dobrze. Natomiast ile z tych pięknych idei da się przełożyć na konkretne przepisy i gdzie Komisja zostanie zmuszona do kompromisu z rzeczywistością, to się dopiero okaże.

Czy twoim zdaniem nie można pogodzić rozwoju technologicznego i tzw. europejskich wartości?

To nie jest gra o sumie zerowej. Unia Europejska może szukać trzeciej drogi – może np. inwestować w rozwój interpretowalnych metod analizy danych i tworzyć innowacyjne metody audytowania systemów AI. Można wspierać rozwój i pilnować wartości. Ale nie możemy się w tym pogubić. W RODO jest zasada minimalizowania danych, a więc zbierania tylko tego, co niezbędne. Nie można przestrzegać tej zasady, jednocześnie fetyszyzując dane. Uznawać, że po prostu wypada je mieć i trzymać na wszelki wypadek. Na tym polu w którymś momencie dojdzie do konfliktu.

Uważam, że Unia Europejska powinna się odważyć na konflikt i postawić zastosowaniom sztucznej inteligencji pewne granice. Jedną z takich granic jest przewidywanie przyszłych zachowań ludzi. Wśród badaczy sztucznej inteligencji istnieje konsensus co do tego, że ta technologia świetnie się sprawdza w wykrywaniu obiektywnie istniejących wzorców – np. analizie obrazów czy tłumaczeniu tekstu – ale nie jest magiczną kulą, nie jest w stanie przewidzieć tego, jak w przyszłości zmieni się albo zachowa człowiek. I tego po prostu nie powinniśmy od niej wymagać. Są obszary, w których czytelnych dla uczenia maszynowego wzorców po prostu nie ma, albo są tylko o tyle, o ile je sobie wyobrazimy. Wtedy najczęściej pojawia się problem stereotypów.

Te wszystkie algorytmy układa człowiek. Wbrew pozorom one mają czyjąś twarz, czyjeś założenia, wyobrażenia, stereotypy i uprzedzenia. Dlatego np. zdarza się, że systemy rozpoznawania twarzy dyskryminują mniejszości etniczne – reprodukując de facto szkodliwe konstrukty społeczne.

Oczywiście. Ta technologia nie przyleciała do nas z kosmosu. Sami ją tworzymy, często opierając się na nieuświadomionych założeniach i schematach myślowych, którym sami ulegamy. Przy czym dyskryminacja w wykonaniu algorytmu najczęściej bierze się z danych, jakie zostały do systemu wprowadzone w fazie trenowania modelu. Rzadko, w mojej ocenie, będzie to świadoma decyzja projektujących. Co innego wybór celu, jaki system ma realizować: o tym decyduje człowiek, podobnie jak w przypadku każdej innej technologii. To na tym etapie pojawiają się problematyczne i nierzadko ukryte założenia.

Na przykład w przypadku amerykańskiego systemu COMPAS, który wzbudził duże kontrowersje, takim założeniem było to, że nikt, kto stwarza ryzyko ponownego popełnienia przestępstwa, nie powinien zostać wcześniej zwolniony z więzienia. Projektanci systemu wiedzieli, że „zoptymalizowanie” systemu na ten cel oznacza również zaakceptowanie, że znajdą się przypadki osób niesłusznie odsiadujących dłuższy wyrok mimo dobrego sprawowania. I że wśród nich będzie więcej czarnych, bo tak wyglądają realia amerykańskiego systemu sprawiedliwości. Zaakceptowali pewien koszt – konieczny z punktu widzenia statystyki, ale trudny do przyjęcia w demokratycznym społeczeństwie.

Decyzje podejmowane przez projektantów systemów AI tylko pozornie mają techniczny czy matematyczny charakter. To, jakie błędy akceptujemy, a jakie „karzemy”, trenując model – ma jak najbardziej polityczny wymiar i konkretne, społeczne konsekwencje. Również z tego względu trzeba postawić sztucznej inteligencji granice i stosować tę technologię tylko do rozwiązywania tych problemów, które potrafimy opisać w języku matematyki i statystyki.

Komisja wycofała się z zakazu rozpoznawania twarzy, a 20 lutego dyskutowana była rola AI w policji, prawie karnym, prewencji, używanie danych biometrycznych czy rozpoznawanie twarzy przez policję. W Chinach mamy już 170 milionów kamer i projekt wychwytywania dysydentów, zanim będą mieli szansę się nimi stać. Czyli właśnie przewidywanie ludzkich zachowań w przyszłości.

Wycofanie się z generalnego zakazu stosowania technologii AI do rozpoznawania twarzy jest taktycznie mądrym posunięciem. Po pierwsze, taki zakaz byłby nieskuteczny. Po drugie, akurat w tym obszarze istnieją obiektywne wzorce i da się zrobić to dobrze. Pojawia się oczywiście pytanie o to, kto z takiego narzędzia powinien móc korzystać i czy powinna to być np. policja w czasie demonstracji. W takich miejscach musimy stawiać prawne granice, ale nie zrobi tego za nas Unia Europejska. Nadzór nad działaniami policji to przede wszystkim domena państw narodowych.

Do 19 maja trwają konsultacje. Czy macie jakieś rekomendacje, pomysły, uwagi?

Jak najbardziej i na pewno weźmiemy udział w konsultacjach. Dla nas najważniejsze jest przejście od pięknych idei, o których mówiłam wcześniej, do konkretów. Możemy długo dyskutować o tym, gdzie postawić granice sztucznej inteligencji, i o tym, do czego ta technologia się nadaje, a gdzie stwarza ryzyko. Ale na etapie tworzenia regulacji prawnych potrzebne będą konkretne procedury i narzędzia. Takim narzędziem, które wydaje się niekontrowersyjne i po prostu potrzebne, jest obowiązek impact assessment, czyli przeprowadzania oceny skutków oddziaływania systemu. Samo narzędzie nie jest nowe, zostało oswojone m.in. w procesie tworzenia prawa. Na podobnej zasadzie jak projektowana regulacja prawna, która zawsze ma jakieś skutki społeczne, tak i system AI, który będzie wpływać na decyzje o ludziach, powinien przejść ocenę ryzyka.

Komisja mówi dziś dość enigmatycznie o tym, że ludzie mają prawo wiedzieć, kiedy wchodzą w kontakt ze sztuczną inteligencją.

Ale jednocześnie w Białej księdze przebija pogodzenie się z tym, że AI działa jak „czarna skrzynka”, czyli coś, czego nie da się otworzyć i zrozumieć. Sztuczna inteligencja to realne narzędzie władzy, która dziś wymyka się społecznej kontroli i którego z tego właśnie względu ludzie słusznie się obawiają. Już dziś wiemy, że systemy oparte na AI mogą popełniać tragiczne w skutkach błędy. Źle przygotowane lub używane mogą doprowadzić do tego, że człowiek nie dostanie ważnego świadczenia społecznego, nie będzie przyjęty do pracy, nie zostanie zakwalifikowany na pilną operację medyczną itd. Dlatego musimy wymagać od nich pełnej rozliczalności. Nie jest prawdą, że tego nie da się zrobić albo że interpretowalne modele działają gorzej. Tę tezę negują niezależni badacze. Nie uznaje jej też brytyjski ICO (odpowiednik polskiego UODO), który wspólnie z renomowanym Instytutem Alana Turinga wydał właśnie precyzyjne wytyczne, jak wyjaśniać działanie AI.

Sztuczna inteligencja nie jest bezstronna, ale łatwo ulec takiemu złudzeniu i oddać jej odpowiedzialność za decyzje, które powinni podejmować ludzie.

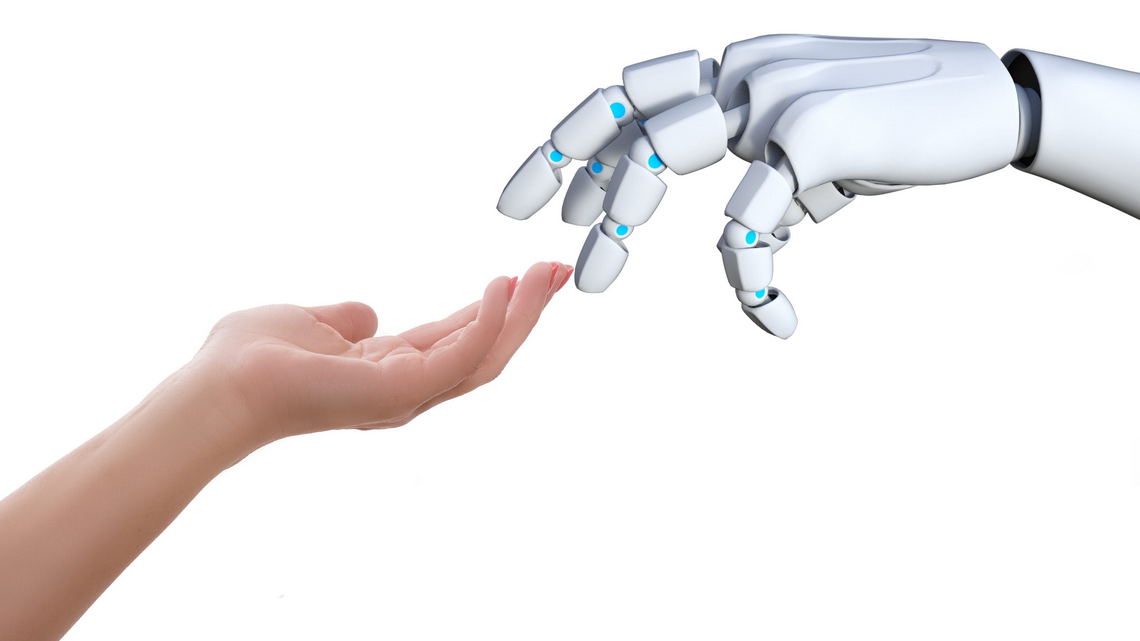

Myślę, że warto inwestować w łączenie tego, co systemy AI potrafią robić naprawdę dobrze, czyli wykrywania obiektywnie istniejących wzorców, z miękkimi umiejętnościami człowieka. Na przykład już wiemy, że AI sprawdza się świetnie w analizie obrazów ludzkiego ciała i wykrywaniu nieprawidłowości (np. wczesnych stadiów raka), bo jest bardziej precyzyjna niż ludzkie oko, ale już do postawienia diagnozy i zalecenia terapii potrzebne jest doświadczenie lekarza i jego wywiad z pacjentem.

Musimy nauczyć się współpracy z maszyną – łączenia kompetencji człowieka i sztucznej inteligencji – a jednocześnie stawiania jej granic, które ochronią nasze wartości. Jeśli uważamy, że powinna istnieć odpowiedzialność za błędy medyczne, to konsekwentnie powinniśmy zabiegać o to, żeby stosowanie AI w diagnostyce medycznej podlegało nadzorowi człowieka. Ale nie jakiegokolwiek człowieka – tylko takiego, który będzie w stanie zachować swoje krytyczne myślenie wobec tej onieśmielającej, „wszechwiedzącej” technologii. To samo dotyczy roli sędziego czy policjanta. To nie jest proste wyzwanie, bo chętnie ufamy „obiektywnym” systemom, wycofujemy swój osąd i instynktownie chronimy się przed odpowiedzialnością. To ludzkie. Ale również krótkowzroczne i niebezpieczne.

Nie unikniemy odpowiedzialności za skutki umieszczenia sztucznej inteligencji „w każdej lodówce” i w każdej polityce publicznej. Wcześniej czy później konsekwencje tej decyzji nas dogonią. Musimy się z nimi zmierzyć jako społeczeństwo i muszą się z nimi zmierzyć politycy. W praktyce to oznacza, że musimy się nauczyć, jak działa ta „magiczna” technologia, i szybko ją odmitologizować.

**

Katarzyna Szymielewicz jest prawniczką specjalizującą się problematyce praw człowieka i nowych technologii; współzałożycielką i prezeską Fundacji Panoptykon.

Wspieraj

Wspieraj

Wspieraj

Wspieraj  Wydawnictwo

Wydawnictwo

Obserwuj

Obserwuj

![Utracony kompas [o europejskiej lewicy]](https://krytykapolityczna.pl/wp-content/uploads/2026/03/plomienie_utracony_kompas-171x267.jpg)

!["Odwagi! [o zaangażowaniu młodych]" Dominika Lasota](https://krytykapolityczna.pl/wp-content/uploads/2026/04/odwagi-plomienie-okladka-173x267.jpg)